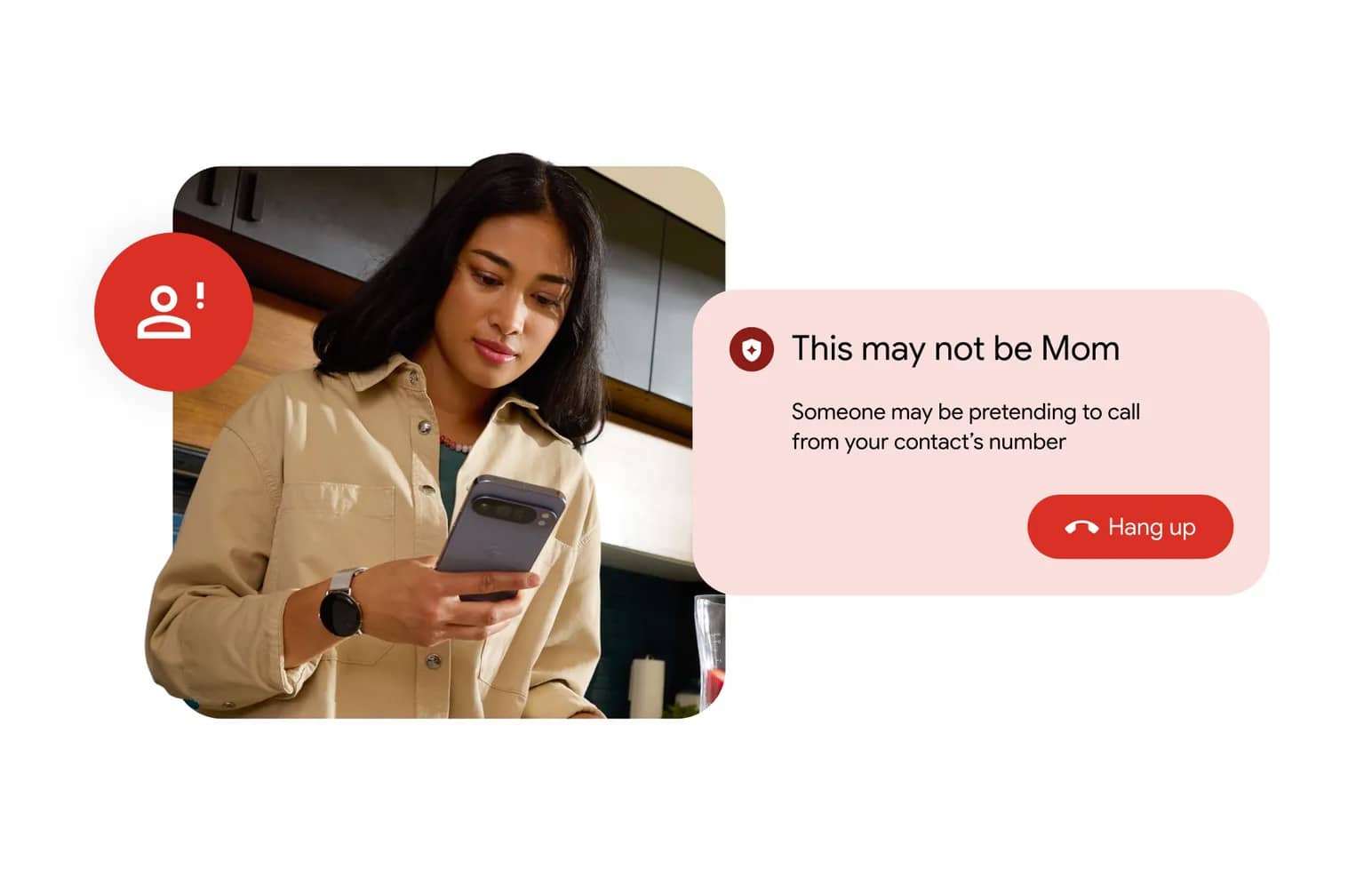

Компанія OpenAI готує систему передбачення віку для ChatGPT. Вона оцінюватиме, скільки років користувачу, і за необхідності буде переводити його у «підлітковий режим». У ньому чат-бот не стане вести флірт або обговорювати суїцид, а при серйозних проблемах компанія зможе зв'язатися з батьками або навіть з владою.

За словами Сема Альтмана, у низці країн та випадків ChatGPT також може вимагати посвідчення особи. Керівник OpenAI визнає, що це компроміс між приватністю та безпекою, але вважає його виправданим заради захисту підлітків.

Для дорослих збережеться більше свободи: наприклад, ChatGPT продовжить допомагати у сценаріях та художніх текстах, навіть якщо вони торкаються складних тем.

Заходи пов'язані з трагедією навесні 2025 року, коли підліток наклав на себе руки після розмови з ChatGPT про суїцид (такі випадки вже не рідкість), і зі зростаючою увагою регуляторів до безпеки підлітків в AI-сервісах.

Джерело: OpenAI

.png)